在AI图像编辑领域,传统模型长期面临空间逻辑混乱的瓶颈:移动物体时出现几何变形、视角切换时场景结构断裂、调整物体层次时遮挡关系错乱。京东探索研究院近日推出的开源模型JoyAI-Image-Edit,通过构建三维空间理解体系,实现了从平面修图到空间重塑的技术跃迁。该模型首次将空间智能深度融入图像生成流程,在物体位移精度、多视角一致性等核心指标上达到国际领先水平。

研发团队突破性构建了空间理解数据与任务体系,涵盖空间位置建模、相机参数感知、场景几何推理等八大维度。通过创新的空间坐标变换算法,模型可精准控制物体在三维场景中的位移、旋转和缩放,同时自动维护光影一致性、遮挡合理性等物理规律。实验数据显示,在物体移动任务中,该模型的空间变形率较传统方法降低82%,多视角图像序列的几何误差控制在3%以内。

该模型三大核心能力重新定义了AI图像编辑范式:视角变换功能支持通过自然语言指令调整相机参数,在保持场景结构完整的前提下生成新视角图像;空间漫游技术可连续生成逻辑连贯的多视角序列,实现虚拟场景中的"自由行走";物体关系操控允许用户精准调整特定物体的空间属性,系统自动优化周边元素的遮挡与光影关系。这些能力与15类通用编辑功能深度融合,形成覆盖内容创作全流程的解决方案。

在电商领域,该模型可自动生成多角度商品展示图,将传统3D建模周期从72小时压缩至8分钟;在创意设计场景,设计师通过文本指令即可完成复杂场景的空间重组,创作效率提升5倍以上。特别在具身智能领域,模型提供的空间感知能力为机器人环境理解提供了关键技术支撑,相关应用已在仓储物流机器人中开展测试。

此次开源包含完整的模型架构、训练代码和推理引擎,开发者可基于现有框架快速构建空间感知类应用。配套发布的空间编辑工具包已集成至京东云平台,支持一键部署和二次开发。与同期开源的JoyAI-LLM Flash大模型形成技术协同,京东正在构建覆盖文本、图像、3D空间的多模态AI技术矩阵。

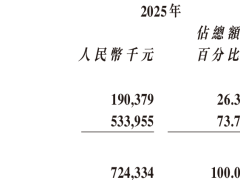

在产业应用层面,京东云"龙虾"系列产品凭借该模型的空间处理能力,实现智能图像处理服务的周调用量增长455%。正在建设的全球最大具身数据采集中心,将通过该模型生成海量标准化空间数据,加速机器人视觉系统的训练优化。这些布局彰显了京东以空间智能为突破口,推动AI技术深度融入实体经济的战略决心。