在五一假期前夕,阿里巴巴正式开源了其最新一代通义千问模型——Qwen3。这款模型以其精简的参数量和显著的成本效益引发了广泛关注。据悉,Qwen3的参数量仅为DeepSeek-R1的三分之一,但其性能表现却毫不逊色。

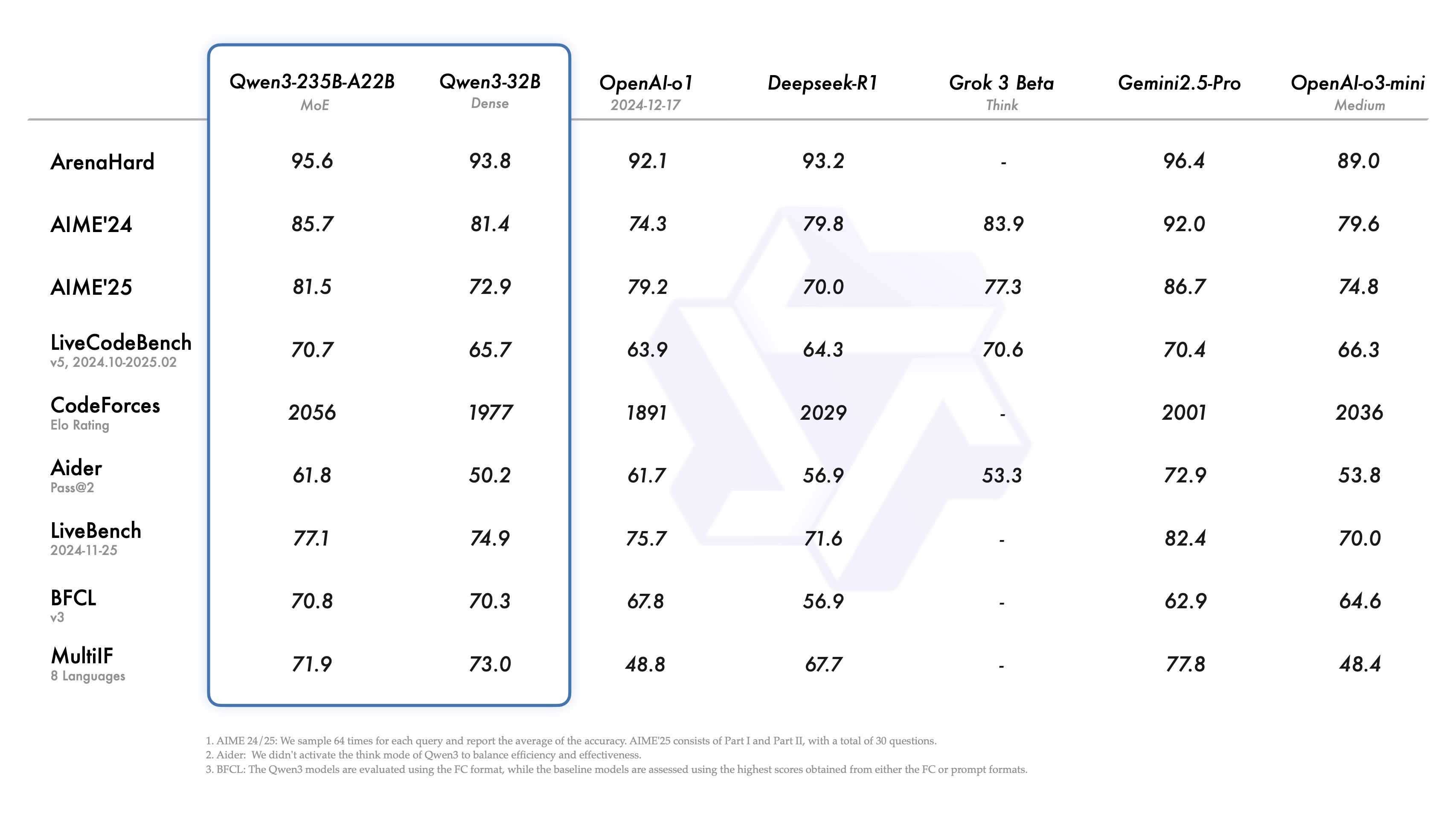

据报告显示,Qwen3在多个基准测试中表现卓越,超越了包括DeepSeek-R1、o1、o3-mini、Grok-3和Gemini-2.5-Pro在内的全球顶尖模型,成功登顶全球最强开源模型的宝座。特别是在代码、数学和通用能力等方面的测试中,Qwen3展现出了强大的实力。

Qwen3之所以能够在参数量减少的情况下依然保持高性能,得益于其模型架构的改进、训练数据的增加以及更高效的训练方法。与上一代Qwen2.5基础模型相比,Qwen3在体积更小的同时,性能表现也更为出色。特别是在STEM、编码和推理等领域,Qwen3 Dense基础模型的表现甚至超过了更大规模的Qwen2.5模型。

阿里巴巴在官方博客中透露,Qwen3 Dense基础模型的整体性能与参数更多的Qwen2.5基础模型相当。例如,Qwen3-1.7B/4B/8B/14B/32B-Base分别与Qwen2.5-3B/7B/14B/32B/72B-Base在性能上不相上下。这一数据无疑进一步证明了Qwen3的强大实力。

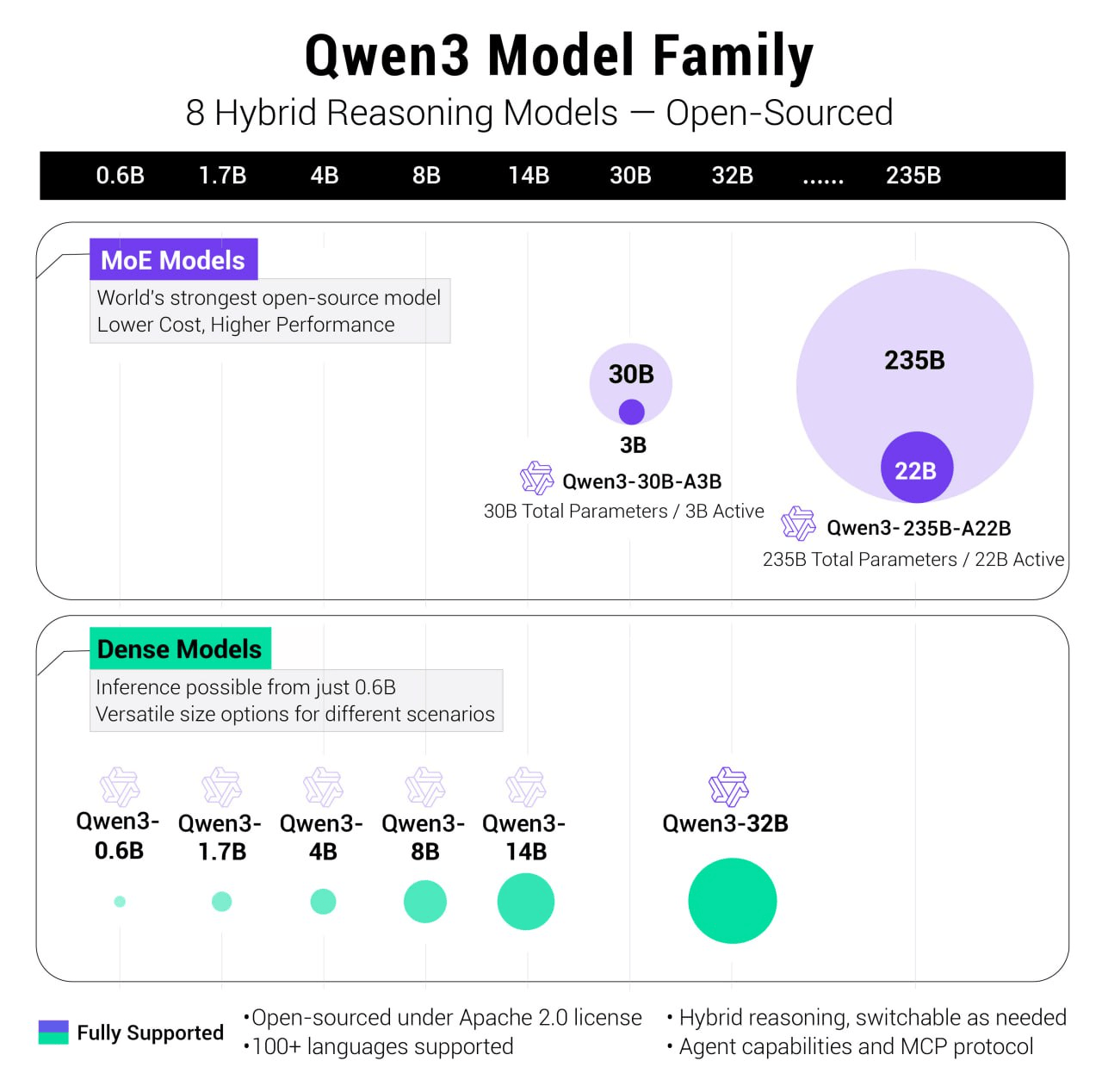

Qwen3不仅拥有235B参数的MoE模型,还配备了一个小型MoE模型——Qwen3-30B-A3B。尽管该模型的激活参数量仅为3B,不及QwQ-32B模型的十分之一,但其性能却更为优异。这得益于MoE架构的独特设计,它能够将不同的问题分配给最适合的专家来处理,从而提高查询的计算效率。

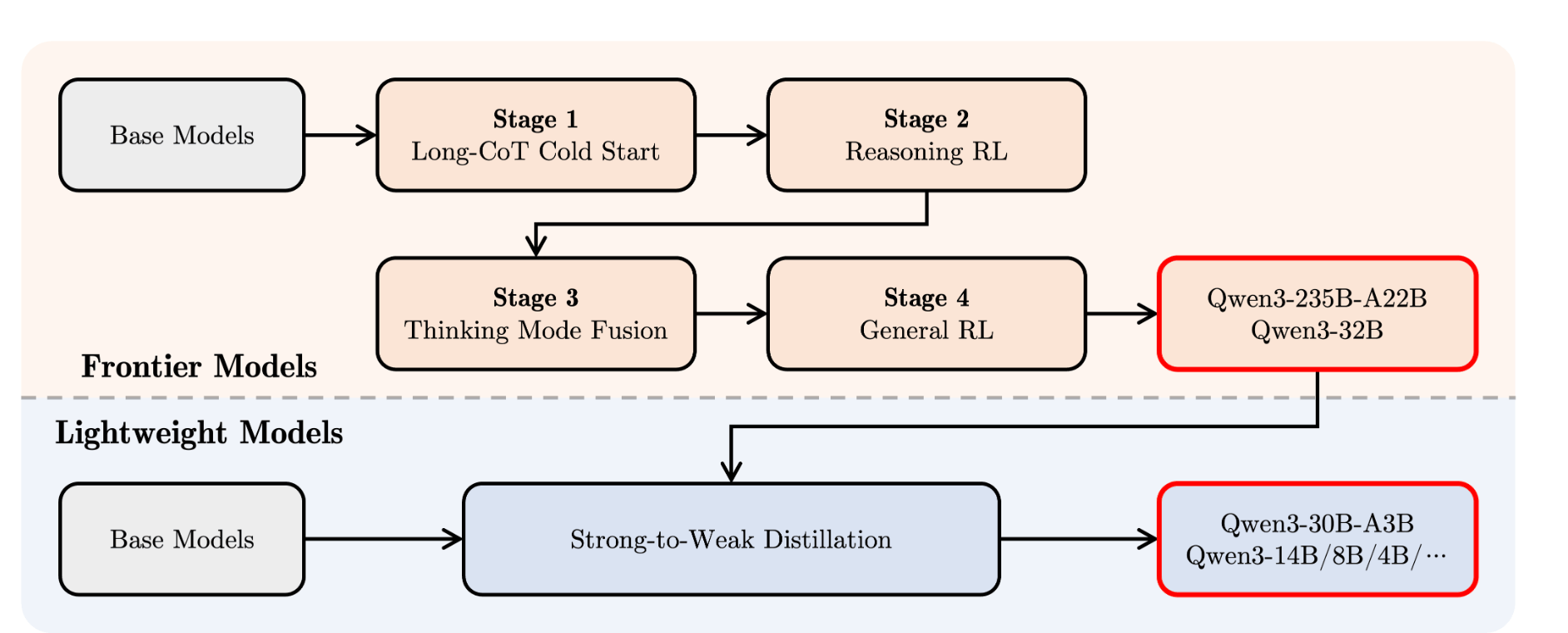

此次阿里巴巴开源的模型包括Dense模型和MoE模型两大类。其中,开源了两个MoE模型的权重:一个是拥有2350多亿总参数和220多亿激活参数的Qwen3-235B-A22B大模型,另一个是拥有约300亿总参数和30亿激活参数的Qwen3-30B-A3B小型MoE模型。六个Dense模型也已开源,包括Qwen3-32B、Qwen3-14B、Qwen3-8B、Qwen3-4B、Qwen3-1.7B和Qwen3-0.6B,这些模型均在Apache 2.0许可下开源,可直接用于商业用途。

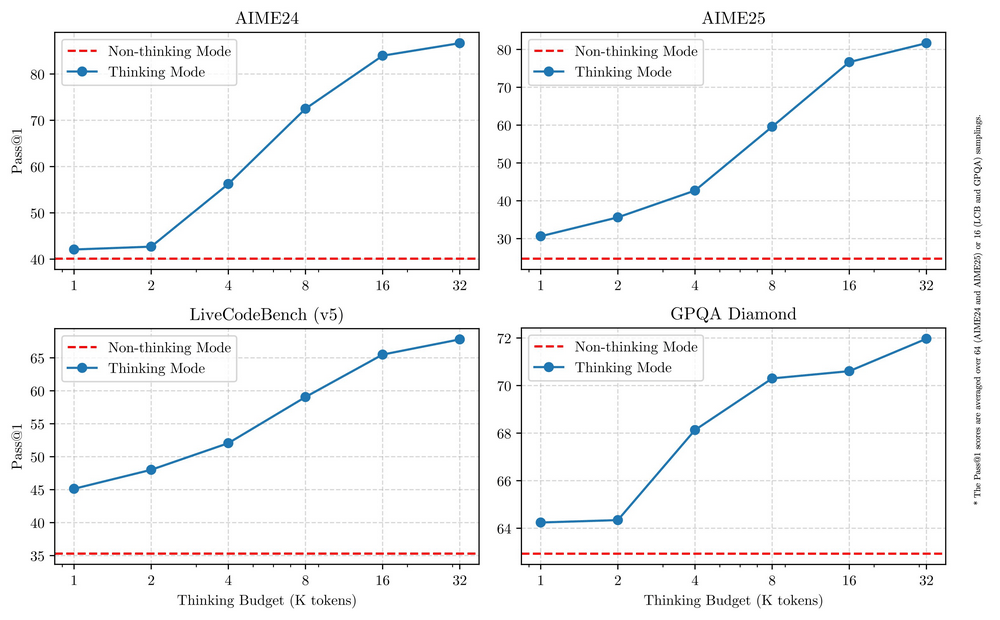

Qwen3系列的另一个创新点在于其“混合型”模型设计。这种设计使得模型能够在深度思考(用于复杂的逻辑推理、数学和编码)和快思考(用于高效、通用的聊天)之间无缝切换,从而在各种场景下实现最佳性能。用户无需手动操作开启或关闭“深度思考”功能,也无需担心模型过度思考的问题。这一设计不仅提高了用户体验,还有效降低了成本。

在部署方面,阿里巴巴表示,仅需4张H20显卡即可部署Qwen3满血版,显存占用仅为性能相近模型的三分之一。这意味着与满血版DeepSeek R1相比,Qwen3的部署成本降低了65%~75%。这一数据无疑为Qwen3的广泛应用提供了有力支持。

阿里巴巴还介绍了Qwen3的四阶段训练流程,包括基础训练、深度思考训练、混合快慢模式训练和全面优化。这一流程确保了Qwen3在工具调用、指令执行和数据格式处理方面表现出色。阿里巴巴建议搭配Qwen-Agent使用,以简化工具调用的代码实现。此次,阿里巴巴还专门优化了Qwen3模型的Agent和代码能力,并加强了对MCP的支持。