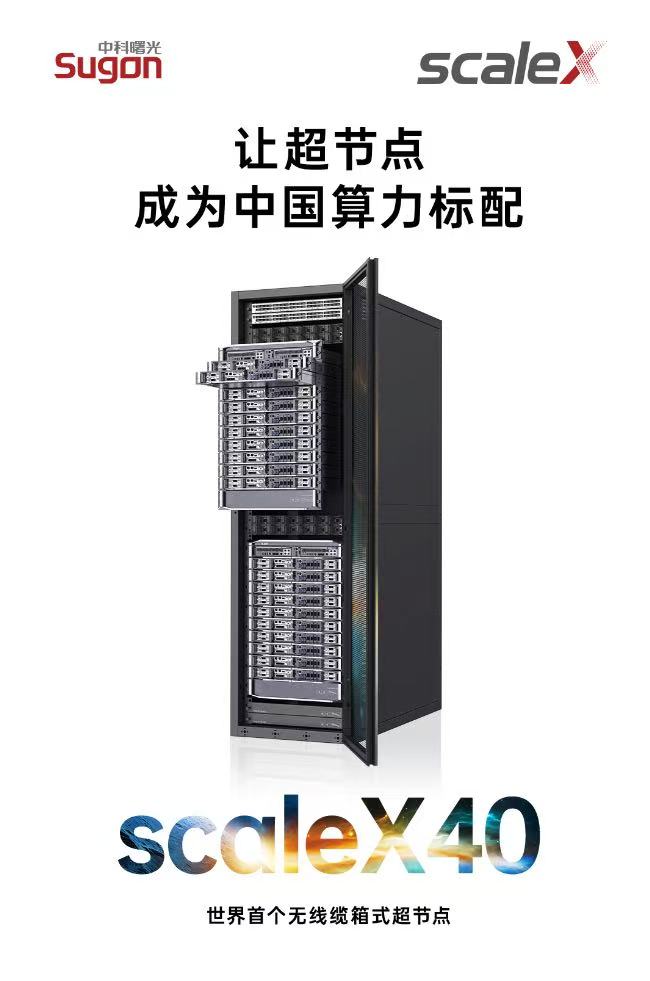

近日,中科曙光发布全球首款无线缆箱式超节点scaleX40。没有一直标榜高参数,也未宣示其遥遥领先,但这款面向企业级AI用户的“小而美”超节点,传递出一个清晰信号——国产超节点正在形成“双轨制”。

一边用大规模超节点探索技术边界,定义性能上限;另一边以中小规模超节点作为普及主力,降低企业试错门槛。双向奔赴之下,国产高端算力或将真正走进主流市场。

AI算力部署要过“三重门”

近年来,随着AI赛道持续爆发,大模型从参数竞赛走向应用落地,智能体浪潮席卷千行百业,催生出海量、实时、复杂的计算需求。从金融风控到工业质检,从医疗影像到科研仿真,AI算力正在从“少数人的游戏”变成“全行业的工具”。

然而,机遇之下挑战并存。联想AI资深架构师耿太平指出,当前企业部署AI算力正面临三大痛点:场景割裂、扩展僵化、运维黑洞。

一方面,训练集群、推理集群、智能体集群往往分立建设,数据和模型状态需要在不同系统间“搬家”,不仅成本高昂,还拖慢了业务迭代效率;另一方面,算力采购也陷入两难,要么起步就是巨大投资,上马百卡级超节点,要么很快触达8卡机性能天花板,无法平滑扩容。

对于大部分中小企业来说,目前很难找到一条“起步即适用、扩容不浪费”的路径。而且传统的算力系统复杂度非常高,用户往往还未抵达前两重门户,就被冗杂的部署流程劝退,即便强行上手,IT团队的大量精力也被消耗在故障排查和环境适配上,难以聚焦业务创新。

耿太平认为,这三重困境指向一个根本矛盾:企业需要敏捷、多态、异构的AI能力,面对的却是僵化、单一、封闭的基础设施。这个矛盾不解决,AI的规模化普及就无从谈起。

超节点突围走向“双轨制”

在AI算力部署多重困境下,超节点产品必须同时服务于两个目标:既要“探索前沿”,为头部场景提供极致性能;又要“普及应用”,让更多企业能用得起、用得好。

“AI算力的核心挑战,已从单点性能转向系统协同。”中科曙光高级副总裁李斌在发布会上指出,scaleX40的意义不止于性能提升,更在于重构算力交付逻辑,推动算力从“工程化建设”走向“产品化供给”,大幅降低高端算力的使用门槛与落地成本。

这恰恰是“双轨制”的核心理念:用大规模超节点定义上限,用中小规模超节点拉高底线。

作为高端算力普及主力的scaleX40,在设计上瞄准了三个关键维度:

第一,降低采购和部署门槛。与传统8卡机方案相比,scaleX40成本基本持平,将超节点采购门槛从“亿元级”拉低至“千万级”。同时采用标准19英寸箱式设计,计算节点与交换节点通过无线缆正交对接,用户无需机房改造,推入机柜、接通电源和网络,几小时内即可完成部署。相比光纤连接,功耗下降40%-70%;相比铜缆模式,可用性提高10倍。

第二,满足主流AI计算需求。scaleX40内置40张AI加速卡,总算力超过28 PFLOPS(FP8精度),HBM总显存超过5TB,访存带宽超过80TB/s,40张卡通过一级Scale-Up全互连,聚合带宽超过17TB/s。这一配置足以承载千亿级模型的训练和推理,覆盖互联网、金融、医疗、科教、电网、运营商等六大行业的主流应用场景。

第3,让企业“用得好”超节点。曙光为scaleX40配套了完整的全栈技术矩阵:ParaStor存储系统解决“算力狂奔、存力不足”的矛盾,存算网三级协同实现训推效率与带宽的显著提升;SothisAI一站式开发运维平台支持一键部署、自动断点续训、故障智能隔离,用户无需组建专业运维团队即可完成全流程业务应用。

从产业视角来看,国产超节点的“双轨制”探索,正在回应一个长期被忽视的市场需求:大多数企业需要的不是峰值性能的极限突破,而是能够在合理成本下稳定运行、灵活扩展的算力基础设施。既要仰望星空,也要脚踏实地。这也许才是中国AI计算的堂皇大道。