近年来,随着人工智能大模型训练规模从千卡迈向万卡甚至十万卡,算力集群的互联网络正从幕后走向台前,成为决定系统效能的核心要素。过去,行业普遍认为GPU数量是制约训练效率的关键,但实践表明,当计算节点突破万卡规模后,节点间的数据通信延迟与带宽瓶颈,往往导致算力利用率不足50%,部分极端场景下通信开销甚至占据总训练时间的半壁江山。这种“算力黑洞”现象,迫使全球AI基础设施领域掀起一场关于高速互联技术的革命。

传统上,InfiniBand架构凭借低延迟、高带宽的优势,长期主导高性能计算互联市场,全球超60%的超级计算机采用该技术。然而,当AI训练迈入十万卡时代,其设计缺陷逐渐暴露:单子网规模受地址空间限制难以突破五万卡,且产业链高度依赖海外厂商,从高速SerDes IP到交换芯片均被少数企业垄断。这种技术封锁与规模瓶颈的双重压力,倒逼国内探索自主可控的RDMA网络技术路径。

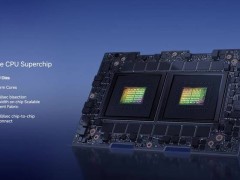

以中科曙光研发的scaleFabric为例,这条被业界称为“国产IB”的技术路线,选择从底层芯片到软件栈全栈自研。其核心芯片包括400G RDMA网卡与高性能交换芯片,均基于自主研发的112G SerDes技术,实现单端口带宽397Gbps、端到端延迟0.9微秒的硬指标,达到国际主流NDR InfiniBand水平。更关键的是,通过重构网络地址编码与路由体系,scaleFabric将单子网规模扩展至11万卡,较传统架构提升2.3倍,为未来更大规模集群预留了技术空间。

在郑州万卡集群项目中,这套国产网络展现了惊人的工程能力。从设备进场到训练任务启动仅用30小时,较传统方案缩短70%部署周期。其秘密在于自动化运维体系:通过数字孪生技术实时映射物理网络状态,结合主动压测与集中版本管理,将链路校准、参数调优等繁琐工作转化为标准化流程。这种“交付难度曲线压平”的突破,让运维团队得以同时管理多个万卡集群,彻底改变了AI基础设施的工程实践范式。

针对AI训练特有的通信模式,scaleFabric创新性地提出iLossless智能无损网络与SuperTunnel通信优化体系。在辐照材料分子动力学模拟等场景中,万卡集群并行效率维持在80%-86%;堆芯流体力学测试中,通信开销从50%压缩至10%,彻底解决了传统以太网方案在大规模场景下的拥塞风暴问题。更值得关注的是其“可定义网络”能力——通过开放硬件接口与协议栈,系统可针对自动驾驶、科研超算等场景,动态分配存储I/O与计算同步带宽,实现算力、存储与网络的深度协同。

这场互联网络革命的影响远超技术层面。当算力、存储与网络三大子系统均实现自主可控后,中国AI基础设施正从“替代进口”转向“重构边界”。例如,传统集群设计受限于InfiniBand的五万卡规模上限,而国产方案将这一边界推至11万卡,为区域级乃至跨中心AI集群铺平道路。在产业生态层面,自主标准正推动形成开放互联规范,使不同厂商的芯片、服务器与存储系统能够在统一框架下协同演进,避免整个产业受制于单一封闭协议。

目前,国产RDMA网络已在国内多个智算中心落地,其高密度端口、低组网成本与灵活扩展性,正在重塑AI基础设施的成本结构与工程模式。随着下一代交换芯片研发提速,中国正以scaleFabric为支点,定义符合自身产业需求的技术标准。这条路径或许不同于西方传统方案,但正如某架构师所言:“技术攀登的终点是相同的,区别在于我们选择用自己的方式翻越算力巅峰。”