近日,OpenAI发布了GPT-Image-2模型,引发了科技界和社会的广泛关注。这款新模型被描述为图像生成技术的一次重大突破,其核心升级点在于文字渲染、多语言支持以及视觉推理能力的显著提升。这一进展标志着图像生成技术进入了一个全新阶段,AI生成的图像质量达到了前所未有的高度。

随着新模型的推出,网络上迅速涌现出大量以假乱真的AI生成内容。例如,一张虚构的"官宣图"显示苹果公司CEO库克将于今年9月卸任并加入小米汽车,这张图片几乎无法与真实照片区分开来。这种现象引发了人们对AI生成内容真实性和潜在风险的深入思考。

与早期文生图技术相比,GPT-Image-2实现了质的飞跃。过去的技术主要依赖于理解指令后拼贴现有素材,而新模型能够以信息产品的逻辑直接生成高质量成品,包括充满文字的海报、菜单,以及将真实人物融入虚拟环境的逼真图像。这种能力使得AI不再仅仅是"图像玩具",而是成为可以"仿真拍摄、模拟制图"的强大工具。

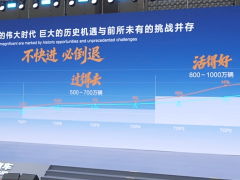

从生产力角度看,这项技术进步带来了显著积极影响。教育、设计、商业传播等领域将受益匪浅,普通用户无需专业技能也能快速制作专业级的视觉内容。对于图片生产行业而言,这无疑是一次产业性的生产力提升机遇,大幅降低了创作门槛,提高了效率。

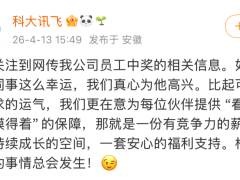

然而,技术进步也带来了新的挑战。AI生成内容的逼真程度使得虚假信息、版权侵权等风险大幅增加。过去需要专业技能才能实现的AI造假,现在借助大模型工具可以批量生产且毫无痕迹。从聊天截图到广告海报,各种类型的虚假内容都可以被完整生成,这对信息真实性构成了严重威胁。

当AI生成的图片不仅逼真,还能主动植入信息元素诱导读者时,普通用户更容易放松警惕。近期网络上流传的各种虚假图像事件,正是这一技术能力在信息伦理层面影响的初步显现。这提醒我们,应对AI图片带来的挑战不能仅依赖用户提高警惕。

我国已出台《人工智能生成合成内容标识办法》,要求对AI生成内容进行显式和隐式标识,平台也负有核验和提示义务。当前关键在于,各内容平台需要建立切实可行的识别机制和责任划分体系,特别是针对站外AI图片的二次传播问题。这需要技术能力、规则制定和执行力度三方面的同步提升。

具体而言,平台应将AI标识设为默认选项而非可选装饰,对热点事件、名人相关等高风险图片强化溯源和风险提示。各方需建立基本的图片核验流程,避免盲目转发未经核实的内容。只有形成这样的机制,才能在享受技术红利的同时,有效维护信息真实性。

技术发展使图像表达能力大幅提升,但不应以牺牲世界真实性为代价。在AI图片日益普及的今天,重建公众对图像内容的信任变得比快速交付图片更为重要。这需要监管者、技术企业、平台和创作者共同努力,通过规则制定和技术手段守护信息真实的基本底线。